本站3月27日消息,今天,阿里云宣布通義千問Qwen2.5-Omni-7B正式開源。

這是通義系列模型中首個端到端全模態(tài)大模型,可同時處理文本、圖像、音頻和視頻等多種輸入,并實時生成文本與自然語音合成輸出。

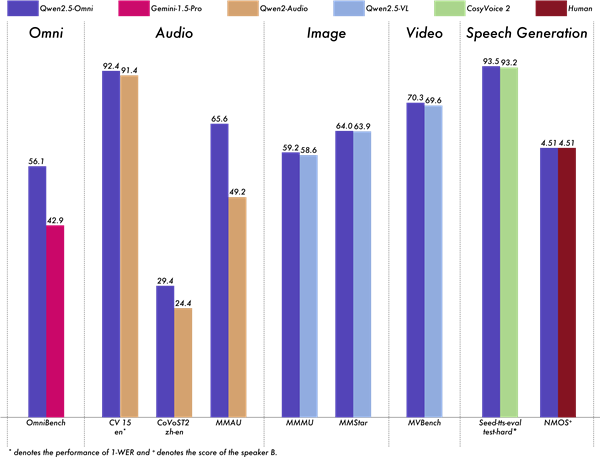

在權(quán)威的多模態(tài)融合任務(wù)OmniBench等測評中,Qwen2.5-Omni刷新業(yè)界紀錄,全維度遠超谷歌的Gemini-1.5-Pro等同類模型。

阿里云表示,相較于動輒數(shù)千億參數(shù)的閉源大模型,Qwen2.5-Omni以7B的小尺寸讓全模態(tài)大模型在產(chǎn)業(yè)上的廣泛應(yīng)用成為可能。

即便在手機上,也能部署和應(yīng)用Qwen2.5-Omni模型。

目前,Qwen2.5-Omni已在魔搭社區(qū)和Hugging Face 同步開源,用戶也可在Qwen Chat上直接體驗。

據(jù)悉,2023年起,通義團隊陸續(xù)開發(fā)覆蓋0.5B、1.5B、3B、7B、14B、32B、72B、110B等參數(shù)的200多款全尺寸大模型,囊括文本生成模型、視覺理解/生成模型、語音理解/生成模型、文生圖及視頻模型等全模態(tài)。

開源地址:

https://huggingface.co/Qwen/Qwen2.5-Omni-7B

https://modelscope.cn/models/Qwen/Qwen2.5-Omni-7B

https://github.com/QwenLM/Qwen2.5-Omni

鄭重聲明:本文版權(quán)歸原作者所有,轉(zhuǎn)載文章僅為傳播更多信息之目的,如作者信息標記有誤,請第一時間聯(lián)系我們修改或刪除,多謝。