“搜索不是終點(diǎn),是開(kāi)始”,谷歌20多年前在搜索框上寫(xiě)下這句格言時(shí),大概沒(méi)想到自己會(huì)在2025年,把這個(gè)“開(kāi)始”變成了一整個(gè)AI生態(tài)系統(tǒng)。

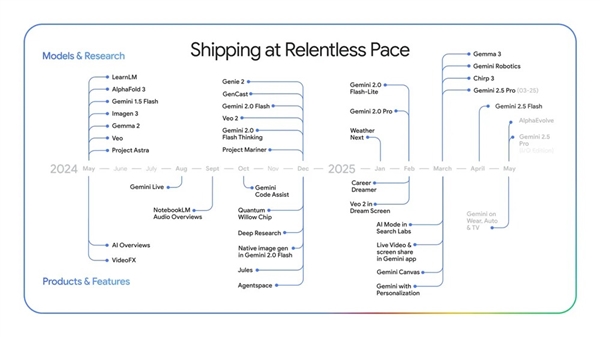

在Google I/O 2025上,這家公司用一場(chǎng)兩個(gè)小時(shí)的發(fā)布會(huì),告訴了全世界什么叫“全家桶攻擊”:新模型、新功能、新硬件、新平臺(tái),谷歌幾乎把整個(gè)科技生態(tài)拎出來(lái)洗了一遍。

從搜索升級(jí)到全知全能的AI助理、從圖文視頻生成到主打空間計(jì)算的XR眼鏡、從編程工具到工作流自動(dòng)化,別說(shuō)你是用戶了,現(xiàn)在你哪怕是只貓,Google都能試著用AI服務(wù)你。

月活四億的Gemini

就在一年前,谷歌每月處理的 token 還不到10萬(wàn)億,而如今,這個(gè)數(shù)字已經(jīng)飆升到了480萬(wàn)億,翻了整整50倍。與此同時(shí),超700萬(wàn)名開(kāi)發(fā)者正在用Gemini搭建AI應(yīng)用,是去年的5倍,Vertex AI上的使用量也增長(zhǎng)了40倍。

至于Gemini應(yīng)用,更是坐擁4億月活用戶,其中使用2.5 Pro模型的用戶活躍度上漲了45%。簡(jiǎn)單來(lái)說(shuō):AI的浪潮不僅來(lái)了,而且人人都在沖浪。

AI無(wú)處不在,搜索不再只是“搜索”

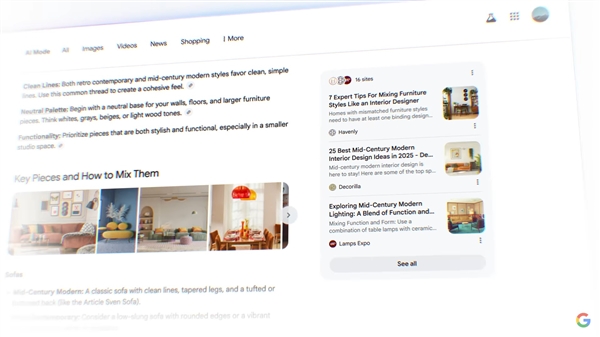

搜索是谷歌的老本行,但今年的I/O大會(huì)上,搜索不再是關(guān)鍵詞匹配的工具,而是徹底重構(gòu)了的“AI助理”。谷歌推出了全新的AI模式(AI Mode),這是比去年的AI Overview更進(jìn)一步的功能進(jìn)化。

這個(gè)模式不僅支持自然語(yǔ)言對(duì)話式搜索,還具備多模態(tài)識(shí)別能力、深度搜索能力以及主動(dòng)理解上下文的能力。

舉個(gè)例子:如果你在搜索“北京大望路附近午餐推薦”,它會(huì)自動(dòng)生成一份專(zhuān)家級(jí)的推薦清單,結(jié)合價(jià)格、口味、評(píng)分、是否能外賣(mài)等維度——比本地生活A(yù)pp更懂你。你甚至可以上傳一張街景圖,直接讓它“識(shí)圖找飯館”。

而這背后的技術(shù)核心是谷歌定制的Gemini模型,它能將一個(gè)復(fù)雜問(wèn)題拆解為多個(gè)子查詢,在背后執(zhí)行數(shù)百次搜索,再綜合成一個(gè)結(jié)構(gòu)化結(jié)果。這不僅是信息聚合,而是知識(shí)重建。

更重要的是,AI能記住你。它支持訪問(wèn)你的搜索歷史、Gmail、日歷等上下文信息(需授權(quán)),讓搜索結(jié)果更加貼合個(gè)人需求。舉例來(lái)說(shuō),如果你總點(diǎn)麻辣燙,它不會(huì)一遍遍推日料給你——你吃過(guò)的,它記得。

Gemini全家桶升級(jí),模型能力再度躍遷

作為本屆I/O的核心主角,Gemini模型全線升級(jí)。重點(diǎn)來(lái)了三個(gè)新版本:

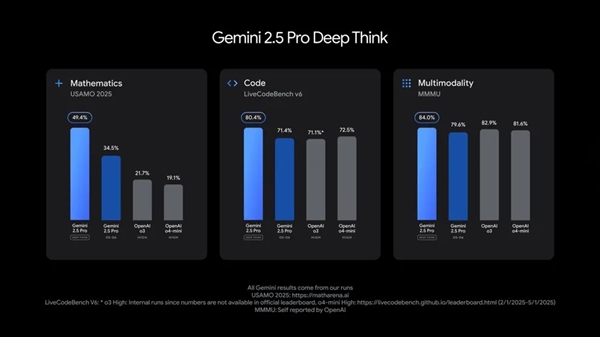

Gemini 2.5 Pro Deep Think:強(qiáng)化推理能力,專(zhuān)為數(shù)學(xué)、編程等高復(fù)雜度任務(wù)設(shè)計(jì)。在美國(guó)數(shù)學(xué)奧林匹克(USAMO)上拿下40.4%高分,表現(xiàn)超過(guò)GPT-4 Turbo。

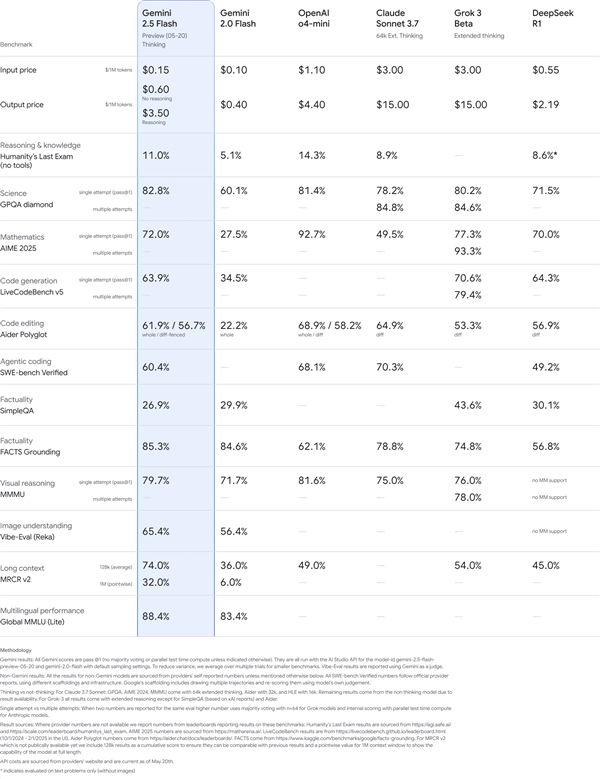

Gemini 2.5 Flash:強(qiáng)調(diào)效率和成本,在保持多模態(tài)理解的同時(shí),token使用減少30%,更適合高頻日常調(diào)用。

Gemini Diffusion:一種全新的擴(kuò)散式文本生成模型,文本生成速度比以往快5倍,每秒可生成超過(guò)10,000 token,特別適合編輯和快速創(chuàng)作。

此外,谷歌還引入了原生音頻生成功能,讓模型說(shuō)話時(shí)能保留語(yǔ)調(diào)、情緒甚至口音細(xì)節(jié)。你講四川話,它也能跟上;你低聲私語(yǔ),它不會(huì)高聲回應(yīng)。

這些模型已經(jīng)集成到了多款服務(wù)中,包括搜索、Chrome、Docs、Gmail以及新的創(chuàng)意平臺(tái)Flow、編程助手Jules等,幾乎覆蓋了你在線上的所有工作和生活場(chǎng)景。

從Chat到眼鏡:Gemini進(jìn)入現(xiàn)實(shí)世界

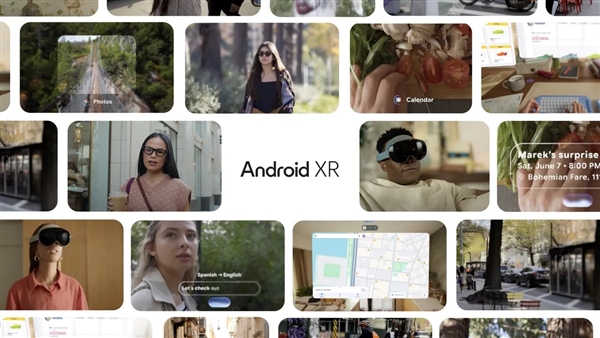

本次發(fā)布會(huì)的另一大看點(diǎn),是谷歌正式推出XR平臺(tái)——Android XR,并帶來(lái)兩款由Gemini驅(qū)動(dòng)的新硬件原型:

Project Moohan:與三星聯(lián)合開(kāi)發(fā)的XR頭顯,主打沉浸式體驗(yàn),對(duì)標(biāo)Vision Pro;

Project Aura:與XREAL合作的輕量AR智能眼鏡,主打日常佩戴體驗(yàn),具備相機(jī)、麥克風(fēng)、揚(yáng)聲器,集成Gemini實(shí)時(shí)感知與語(yǔ)音助手。

谷歌強(qiáng)調(diào),這些硬件并不只是“顯示設(shè)備”,而是Gemini最理想的運(yùn)行載體。配合Gemini Live的攝像頭共享和主動(dòng)提醒能力,眼鏡將成為一種真正意義上的“現(xiàn)實(shí)世界助手”。

比如在演示中,佩戴者正在組裝一輛自行車(chē),眼鏡中的Gemini能自動(dòng)識(shí)別零件并引導(dǎo)組裝步驟;如果你暫停了,它還能“記住”你停在哪,并在繼續(xù)時(shí)從中斷處接續(xù)。整個(gè)體驗(yàn),已經(jīng)相當(dāng)接近科幻片里的“J.A.R.V.I.S”。

視頻生成爆炸性升級(jí),AI電影不是夢(mèng)

內(nèi)容生成方面,谷歌推出了全新的視頻生成模型Veo 3,在圖像清晰度、物理模擬和細(xì)節(jié)控制上都實(shí)現(xiàn)了質(zhì)的飛躍。

最重要的是,它支持原生音頻輸出,也就是說(shuō),AI生成的視頻現(xiàn)在不僅能“動(dòng)”,還能“說(shuō)話”,背景音、對(duì)白、腳步聲一個(gè)不落,基本告別了過(guò)去“啞巴電影”的階段。

配合全新圖像模型Imagen 4(支持2K輸出、文字拼寫(xiě)準(zhǔn)確、風(fēng)格可選)和AI創(chuàng)意平臺(tái)Flow(用于腳本創(chuàng)作、鏡頭生成和角色管理),谷歌幾乎已經(jīng)打造出一個(gè)完整的AI影視創(chuàng)作鏈條。

如果你是一位創(chuàng)作者,從靈感到成片,只需對(duì)Gemini說(shuō)一句“我要拍一部關(guān)于森林里動(dòng)物開(kāi)會(huì)的動(dòng)畫(huà)片”,剩下的它都能幫你搞定。

開(kāi)發(fā)者狂喜:編程助手Jules和Code Assist登場(chǎng)

作為I/O的傳統(tǒng)項(xiàng)目,開(kāi)發(fā)者工具也迎來(lái)了一輪“AI洗禮”。

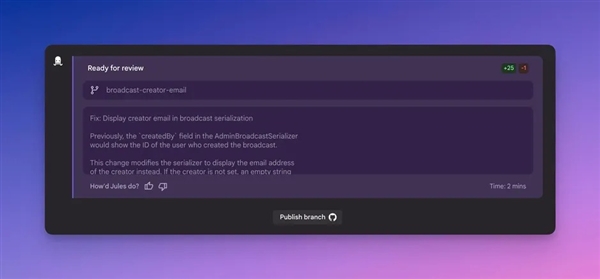

Jules:谷歌推出的編程智能體,可以異步執(zhí)行開(kāi)發(fā)任務(wù),比如自動(dòng)重構(gòu)代碼、編寫(xiě)測(cè)試、升級(jí)依賴(lài)項(xiàng)等。它會(huì)將你的代碼庫(kù)克隆到安全的Google Cloud實(shí)例中,全程私有、無(wú)訓(xùn)練,懂你也尊重你。

Gemini Code Assist:全面升級(jí),支持200萬(wàn)token的上下文,可用于代碼審核、長(zhǎng)文件解析、多人協(xié)作等復(fù)雜場(chǎng)景,還集成了個(gè)性化建議和團(tuán)隊(duì)代碼規(guī)范工具。

此外,還有用于UI開(kāi)發(fā)的Stitch工具,可以用自然語(yǔ)言生成界面和前端代碼,F(xiàn)igma、HTML一鍵導(dǎo)出。

谷歌希望借助這些工具,讓開(kāi)發(fā)者從“寫(xiě)代碼”轉(zhuǎn)向“指導(dǎo)AI寫(xiě)代碼”,真正解放雙手,把人類(lèi)留給更有創(chuàng)意的部分。

天價(jià)訂閱,一價(jià)全包

最后一個(gè)亮點(diǎn),是谷歌推出了新的AI Ultra訂閱,月費(fèi)高達(dá)249.99美元(約合1798.35元人民幣),是目前市面上最貴的AI訂閱之一,比ChatGPT還貴50美元。

但是Ultra版幾乎解鎖了全部功能,包括Veo 3、Imagen 4、Gemini Deep Think模式、30TB云存儲(chǔ)、最早體驗(yàn)新模型的資格,還有Project Mariner多任務(wù)智能體,能自動(dòng)幫你訂票、下單、寫(xiě)總結(jié)……

原來(lái)的Google Advance訂閱現(xiàn)在變成了AI Pro訂閱,價(jià)格不變,還是19.99美元,可以使用Gemini 2.5 Pro模型和深度搜索等功能。教育優(yōu)惠的羊毛不再僅限于美國(guó),也擴(kuò)展到日本、巴西、印度尼西亞和英國(guó),以上地區(qū)的大學(xué)生可以獲得一年的Google AI Pro免費(fèi)使用權(quán)。

谷歌All in AI,不是說(shuō)說(shuō)而已

如果說(shuō)前幾年Google I/O還是一場(chǎng)工程師的大會(huì),今年它更像是谷歌面向世界用戶的AI宣言:我們不僅“能做AI”,而且要“做你的AI”。

Google I/O 2025展示的,不只是功能,而是一種范式:下一代AI產(chǎn)品,不再只是聊天機(jī)器人,而是滲透進(jìn)你每一次搜索、每一個(gè)窗口、每一個(gè)攝像頭,成為你的數(shù)字延伸。

別問(wèn)未來(lái)在哪,點(diǎn)開(kāi)Gemini,可能你就看見(jiàn)了。

鄭重聲明:本文版權(quán)歸原作者所有,轉(zhuǎn)載文章僅為傳播更多信息之目的,如作者信息標(biāo)記有誤,請(qǐng)第一時(shí)間聯(lián)系我們修改或刪除,多謝。